AI 기술이 점점 우리의 삶에 깊숙이 자리잡으면서 윤리적 문제와 신뢰 문제는 중요한 화두가 되고 있습니다. AI 시스템의 투명성, 공정성, 개인정보 보호 문제 등이 이를 사용하는 사용자들에게 신뢰를 줄 수 있는지에 대한 의문을 자아냅니다. 이 글에서는 AI 윤리 문제를 해결하고 신뢰를 높이는 방법을 8가지로 나눠 살펴봅니다.

AI 시스템의 투명성 강화

AI 시스템이 투명성을 가지려면 어떻게 작동하는지에 대한 명확한 설명이 필요합니다.

사용자들은 AI가 어떤 데이터를 사용하고 결과를 도출하는지 이해해야 합니다.

투명성은 신뢰를 높이는 핵심 요소로, 설명 가능한 AI 기술이 중요합니다.

예를 들어, AI 모델이 의사결정을 내리는 과정이 기록되고 설명되어야 합니다.

기업은 내부적으로 AI 알고리즘의 윤리적 검토를 시행해야 합니다.

오픈소스 플랫폼을 통해 투명성을 높이는 것도 한 방법입니다.

결론적으로, 투명한 시스템은 사용자 신뢰도를 증가시킵니다.

공정성 확보

AI가 편견 없이 공정하게 작동하는 것은 매우 중요합니다.

AI 알고리즘의 학습 데이터가 공정해야 결과도 공정할 수 있습니다.

이를 위해 데이터 수집과정에서 다양한 배경과 관점을 포함해야 합니다.

공정성을 검증하기 위한 독립적인 감사가 필요합니다.

공정성을 강화하려면 기업의 윤리 가이드라인도 강화되어야 합니다.

다양한 배경의 전문가 참여로 공정성 문제를 줄일 수 있습니다.

결국, 공정성은 AI의 신뢰와 직결됩니다.

개인정보 보호

AI 시스템은 개인정보를 보호하는 방식으로 설계되어야 합니다.

데이터 암호화와 같은 기술을 활용해 보안을 강화해야 합니다.

AI가 수집하는 데이터의 용도를 명확히 정의하고, 이를 투명하게 공개해야 합니다.

사용자는 자신이 제공한 데이터의 사용 여부를 통제할 수 있어야 합니다.

기업은 데이터 보호를 위해 정기적으로 보안 점검을 수행해야 합니다.

사용자 동의 없이 데이터를 활용하지 않는 것이 중요합니다.

개인정보 보호는 AI 신뢰 구축의 핵심 요소 중 하나입니다.

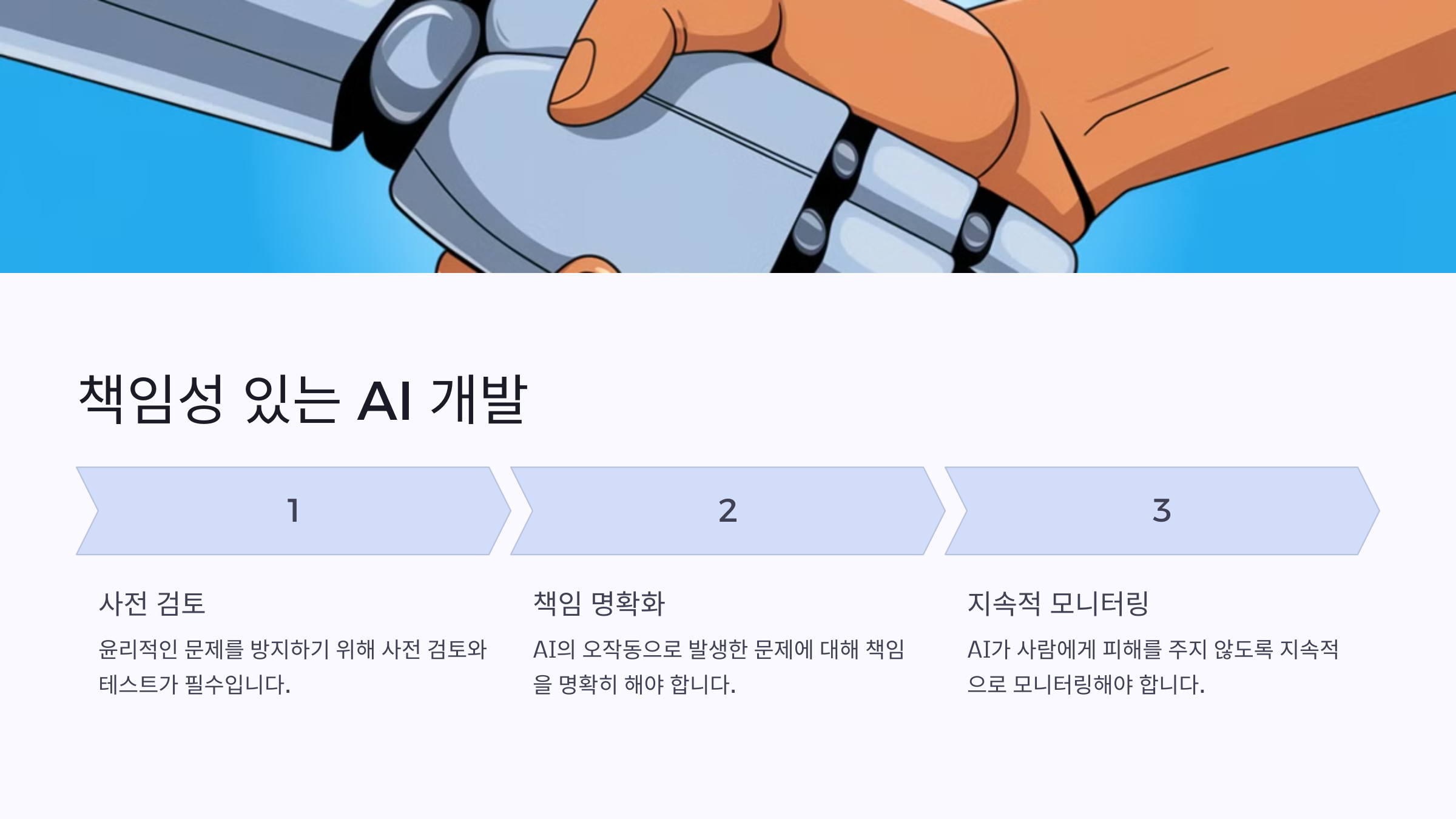

책임성 있는 AI 개발

AI 개발 과정에서 책임감 있는 접근이 중요합니다.

윤리적인 문제를 방지하기 위해 사전 검토와 테스트가 필수입니다.

AI의 오작동으로 발생한 문제에 대해 책임을 명확히 해야 합니다.

책임을 분산하지 않고 명확히 함으로써 신뢰를 높일 수 있습니다.

AI 개발자는 규제와 법률을 준수하며 기술을 개발해야 합니다.

AI가 사람에게 피해를 주지 않도록 지속적으로 모니터링해야 합니다.

책임성 있는 AI는 사회적 신뢰를 형성합니다.

편향성 최소화

AI는 데이터 편향성 문제를 해결해야만 신뢰를 얻을 수 있습니다.

학습 데이터의 다양성을 높여 편향성을 줄여야 합니다.

데이터를 분석해 편향성을 조기에 탐지하고 수정해야 합니다.

AI 시스템 개발 단계에서 편향성 제거 도구를 사용해야 합니다.

독립적인 제3자 기관의 편향성 검증이 필요합니다.

지속적인 데이터 업데이트와 검토로 편향을 줄일 수 있습니다.

편향성 문제를 해결하면 신뢰성이 크게 증가합니다.

인간 참여의 중요성

AI 의사결정 과정에서 인간의 참여는 필수적입니다.

완전 자동화된 시스템은 오히려 신뢰를 떨어뜨릴 수 있습니다.

인간의 개입은 윤리적 판단과 상황별 조정을 가능하게 합니다.

AI의 결과를 모니터링하고 필요 시 수정을 해야 합니다.

AI 시스템 개발에서 인간-기계 협업 모델이 중요합니다.

사용자는 AI를 보조 도구로 사용하며, 최종 결정권을 가져야 합니다.

인간 중심의 AI 설계는 신뢰를 높이는 데 기여합니다.

AI 규제와 표준화

AI 기술에 대한 규제는 책임성을 보장하는 중요한 방법입니다.

국가 및 국제적 수준에서 표준화된 규정이 필요합니다.

이 규제는 AI 개발과 운영에 윤리적 기준을 제공합니다.

규제 준수는 AI가 신뢰를 얻는 데 큰 기여를 합니다.

정부와 산업이 협력해 AI 정책을 수립해야 합니다.

규제는 AI 혁신을 저해하지 않도록 균형을 유지해야 합니다.

결론적으로, 규제와 표준화는 AI 윤리 문제를 해결하는 기반입니다.

사용자 교육과 인식 제고

AI를 안전하고 윤리적으로 사용하는 방법에 대한 교육이 필요합니다.

사용자들은 AI의 한계와 가능성을 이해해야 합니다.

기업은 AI 기술의 윤리적 사용을 촉진하기 위한 교육 프로그램을 제공해야 합니다.

대중 인식 제고는 AI 기술의 수용도를 높이는 데 필수적입니다.

AI 관련 문제를 투명하게 알리는 캠페인이 필요합니다.

사용자 교육은 AI 기술에 대한 신뢰를 증진시킵니다.

교육과 인식 제고는 AI 윤리 문제를 예방하는 중요한 역할을 합니다.

📋 FAQ

AI 윤리의 핵심 원칙은 무엇인가요?

AI 윤리의 핵심 원칙은 투명성, 공정성, 개인정보 보호, 책임성을 포함합니다.

AI의 투명성을 높이는 방법은 무엇인가요?

설명 가능한 AI 기술과 데이터 공개가 투명성을 높이는 주요 방법입니다.

AI의 공정성을 확보하려면 어떻게 해야 하나요?

학습 데이터의 다양성과 독립적인 검증이 필요합니다.

AI가 개인정보를 보호하는 방법은 무엇인가요?

데이터 암호화와 사용자의 데이터 통제 권한을 제공하는 것이 중요합니다.

AI 규제는 어떤 점에서 중요한가요?

규제는 책임감 있는 AI 사용을 보장하며, 윤리적 문제를 예방합니다.

AI에서 인간의 역할은 무엇인가요?

인간은 AI 의사결정을 감독하고 윤리적 판단을 내릴 수 있어야 합니다.

AI 개발자는 어떤 책임을 져야 하나요?

AI가 초래하는 결과에 대해 기술적, 윤리적 책임을 져야 합니다.

AI 편향성을 해결하려면 무엇이 필요한가요?

편향성을 줄이기 위해 데이터 다양성과 지속적인 검증이 필요합니다.

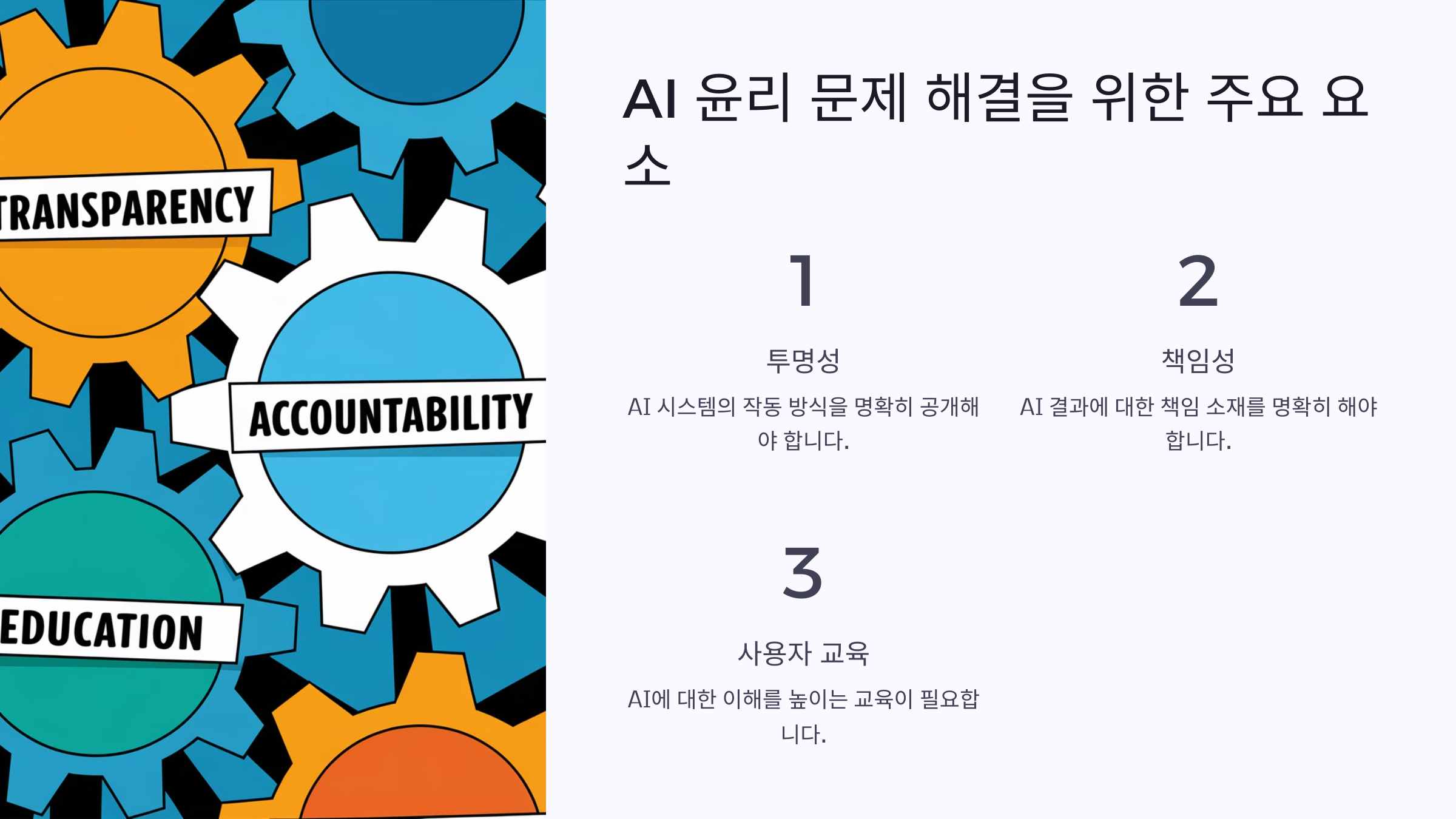

AI 윤리 문제를 해결하는 데 가장 중요한 요소는 무엇인가요?

투명성과 책임성, 그리고 사용자 교육이 가장 중요한 요소입니다.

2025년 AI 공간 지능 트렌드: 로봇, 자율주행, 스마트 홈의 핵심

📋 목차AI 공간 지능이란 무엇인가?로봇 산업에서의 AI 공간 지능자율주행 기술의 혁신스마트 홈과 AI 공간 지능산업 분야에서의 공간 지능 활용AI 공간 지능을 위한 핵심 기술AI 공간 지능의 미

smartinfo-tree.tistory.com

AI 에이전트 기술, 왜 주목해야 하고 어떻게 활용할까?

📋 목차AI 에이전트란 무엇인가?AI 에이전트 기술이 주목받는 이유AI 에이전트의 비즈니스 활용법주요 산업에서의 AI 에이전트 사례AI 에이전트의 주요 이점AI 에이전트 기술의 한계와 도전 과제A

smartinfo-tree.tistory.com

'라이프' 카테고리의 다른 글

| 이더리움이란? 스마트 계약과 탈중앙화 앱(dApp)의 중심 (0) | 2024.12.27 |

|---|---|

| AI 기술로 발전하는 공간 지능: 일상과 산업에 어떤 변화가 올까? (0) | 2024.12.27 |

| 스마트 홈 기술의 미래: 2025년 최신 동향 알아보기 (0) | 2024.12.26 |

| 2025년 인테리어 디자인 트렌드: 최신 동향과 아이디어 모음 (0) | 2024.12.26 |

| 부산 야경 핫플 TOP5✨ 밤하늘이 빛나는 명소들! (0) | 2024.12.26 |